隨著韓國和英國主導的第二屆全球安全高峰會的召開,科技公司已就人工智慧 (AI) 的一系列安全承諾達成協議。

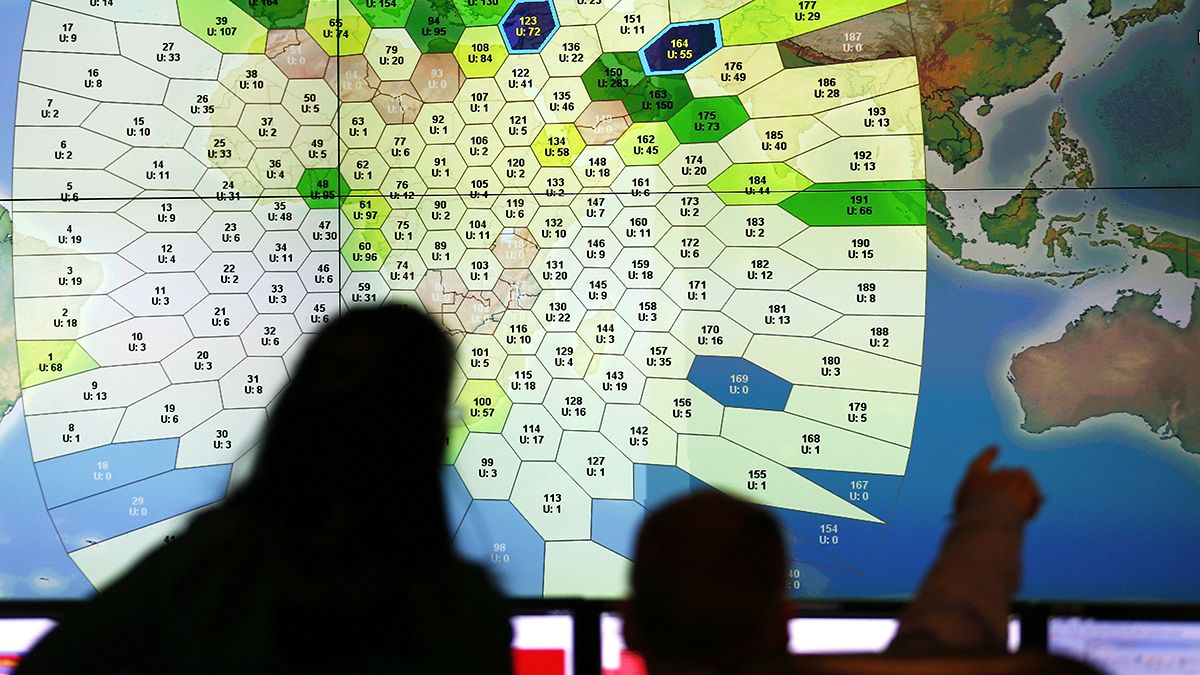

這些自願承諾得到了 16 家主要科技公司的同意,包括 OpenAI、Mistral、亞馬遜、Anthropic、Google、Meta、微軟和 IBM。

中國智普科技與阿聯酋技術創新學院也簽署了該協議。

據一位人士稱,其中包括識別人工智慧可能存在的風險,設定這些風險被指定為過高的閾值,以及對這些風險保持透明。陳述英國政府稱這是歷史性的第一次。

兩家公司也承諾,如果無法降低風險,將暫停人工智慧模型或系統。

該協議是在為期兩天的人工智慧首爾峰會於週二開始時宣布的。此次高峰會是去年在英國布萊切利公園舉行的人工智慧安全高峰會的後續行動。

大型科技公司達成“世界首創協議”

法國將主辦下一次面對面高峰會有關此主題的人。

上一次 11 月會議結束時,近 30 個國家簽署了一份聲明,表示他們將確保人工智慧「以人為中心、值得信賴和負責任」。

本次線上高峰會由英國和韓國聯合主辦,預計世界領導人將達成進一步協議。

英國首相里希·蘇納克在協議簽署後的聲明中表示:「來自全球不同地區的如此多領先的人工智慧公司都同意對人工智慧安全做出相同的承諾,這在世界上尚屬首次。

蘇納克將於週二與韓國總統尹錫烈共同主持與世界領導人的虛擬會議。峰會第二天將包括數位部長之間的討論。

非營利生命未來研究所的政策主管馬克·布拉克爾(Mark Brakel)在向Euronews Next 提供的一份聲明中表示,雖然他對這些公司的承諾表示歡迎,但「至關重要的是,為留住人們所必需的護欄、標準和監督安全已寫入法律」。

「僅憑善意是不夠的。如果人工智慧公司真正真誠地致力於安全,他們應該支持將這些承諾納入監管,」布雷克爾說。

該協議簽署之際,科技公司紛紛推出新的人工智慧模型,該技術在全球加速發展。

推動人工智慧“安全、放心、可信”

上週,OpenAI 宣布了其新模型 GPT-4o,具有更快的功能和 Google揭幕用於搜尋的新 AI 功能以及對其 AI 模型 Gemini 的更新。

谷歌對該模型進行了統計,該公司在開發者大會期間使用“AI”一詞的次數總計為 120 次。

然而共同領導者辭職上週,OpenAI 團隊致力於防止人工智慧系統失控,引發了更多關於安全的擔憂。

該團隊的前聯合負責人 Jan Leike 表示,他辭職的部分原因是“安全文化和流程已經讓位給閃亮的產品”,並補充說 OpenAI 必須成為“安全第一的人工智慧公司”。

人們正在採取多項措施來開始監管該技術,其中包括歐盟世界首部《人工智慧法案》,該法案預計將於下個月生效。

聯合國大會今年稍早還通過了一項關於促進「安全、可靠和值得信賴」的人工智慧的決議。

上個月,美國和英國簽署了一項協議,為最先進的人工智慧模型開發安全測試。